Rob de Veij выпустил обновление своей отличной утилиты инвентаризации VMware vSphere — RVTools версии 4.4.1.

В этой версии исправлено:

- Проблема, требующая, чтобы рабочий каталог был установлен в каталог установки RVTools при использовании сценариев командной строки.

- Проблема, возникающая, когда при копировании/вставке имени хоста или имени пользователя включался ведущий или завершающий пробел.

- Проблема, при которой фоновые ошибки не позволяли успешно завершить работу RVTools в неинтерактивном режиме в качестве запланированного задания.

- Протоколирование ошибок теперь включено по умолчанию для ускорения поиска неисправностей. Ручное переключение на уровень отладки теперь будет запрашиваться только в ситуациях, требующих более подробной информации об устранении неполадок. ПРИМЕЧАНИЕ: Расположение файлов журнала по умолчанию было перенесено в папку AppData/Local/RVTools пользователя.

- Устранена проблема с повреждением csv-файлов при использовании значений, содержащих двойные кавычки.

Добавлено:

- Дополнительная программа улучшения продукта для сбора минимальных анонимных телеметрических данных для использования в целях оптимизации пользовательского интерфейса и эффективности RVTools. Дополнительную информацию смотрите на странице “О RVTools”. *При установке можно отказаться.

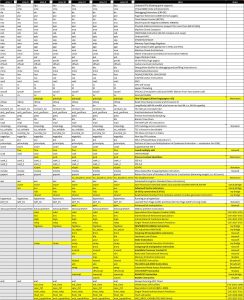

- На странице вкладки vHost появились новые столбцы: Compliance Check State, Domain List, Memory Tiering Type.

- На странице вкладки vHost появились новые столбцы Certificate: Certificate Issuer, Certificate Start, Certificate Expiry, Certificate Status, Certificate Subject.

- На странице вкладки vInfo новые столбцы: Suspended To Memory, Suspend Interval.

- На странице vInfo новые столбцы: Overall Cpu Readiness, Active Memory, Fixed Passthru Hot Plug, Op Notification Timeout, VM Failover In Progress.

- На странице вкладки vInfo новый столбец Customization Info.

- На странице vInfo новый столбец Guest Detailed Data, который включает – architecture, bitness, buildNumber, cpeString, distroName, distroVersion, familyName, kernelVersion, prettyName.

- На странице вкладки vHealth: Добавлено предупреждение “Срок действия сертификата истекает через XX дней или уже истек” (настраиваемые XX дней).

- Свойства Health: Новый флажок для включения/выключения предупреждения об истечении срока действия сертификата и настройки желаемых временных рамок (по умолчанию = 90 дней).